神经网络本质上是一个压缩器

神经网络本质上是一个压缩器:从信息论视角重新理解深度学习

如果把深度学习剥去层层外衣,你会发现它的内核出奇简单——神经网络就是一个有损压缩器。

听起来像是在开玩笑?让我们用信息论的手术刀,解剖一下这个看似荒谬却深刻的观点。

一、压缩的本质:提取规律,丢弃噪声

想象你要向火星人描述"什么是猫"。

你可以选择:

- 方案A:发送10亿张猫的照片(原始数据,未压缩)

- 方案B:描述"有尖耳朵、圆脸、胡须、毛茸茸的四肢,会喵喵叫的小型哺乳动物"(压缩后的规律)

神经网络选择的是方案B。

训练过程,就是网络在不断调整参数,试图找到一个最优的"压缩算法":它从海量数据中提取出猫的本质特征(猫的"柏拉图理型"),丢弃掉光照角度、背景、姿态等噪声信息。

这个过程,和ZIP压缩文件惊人的相似:

- ZIP压缩:找到文件中的重复模式,用更短的编码替代

- 神经网络:找到数据中的统计规律,用更少的参数编码

区别在于:ZIP压缩是无损的,解压后100%还原;神经网络压缩是有损的,但这个"损失"恰恰是泛化的关键。

二、有损压缩的智慧:忘记是为了记住

这里有个反直觉的真相:

如果神经网络100%记住所有训练数据,它就彻底失败了。

为什么?因为100%记忆意味着0%压缩。一个记住每张训练图片像素的网络,本质上是一个查表系统——看到图片A,就查表说"这是猫";看到图片B,就查表说"这不是猫"。这种网络遇到新图片就傻眼了。

真正聪明的网络会适度遗忘:

- ❌ 忘记:这张猫的照片左上角有个红色的像素点

- ✅ 记住:猫有三角形耳朵

- ❌ 忘记:训练集第3427张图片的背景是草地

- ✅ 记住:猫的眼睛是椭圆形的

泛化能力 = 压缩能力

一个泛化性好的网络,本质上是一个高效的压缩器:它用相对少的参数(GPT-3约1750亿参数),压缩了互联网上几乎所有文本的规律。当你问它问题时,它不是在"回忆",而是在解压——从压缩后的规律中,重新生成答案。

三、过拟合与欠拟合:压缩视角的重新诠释

在压缩框架下,深度学习的两大顽疾有了新的解释:

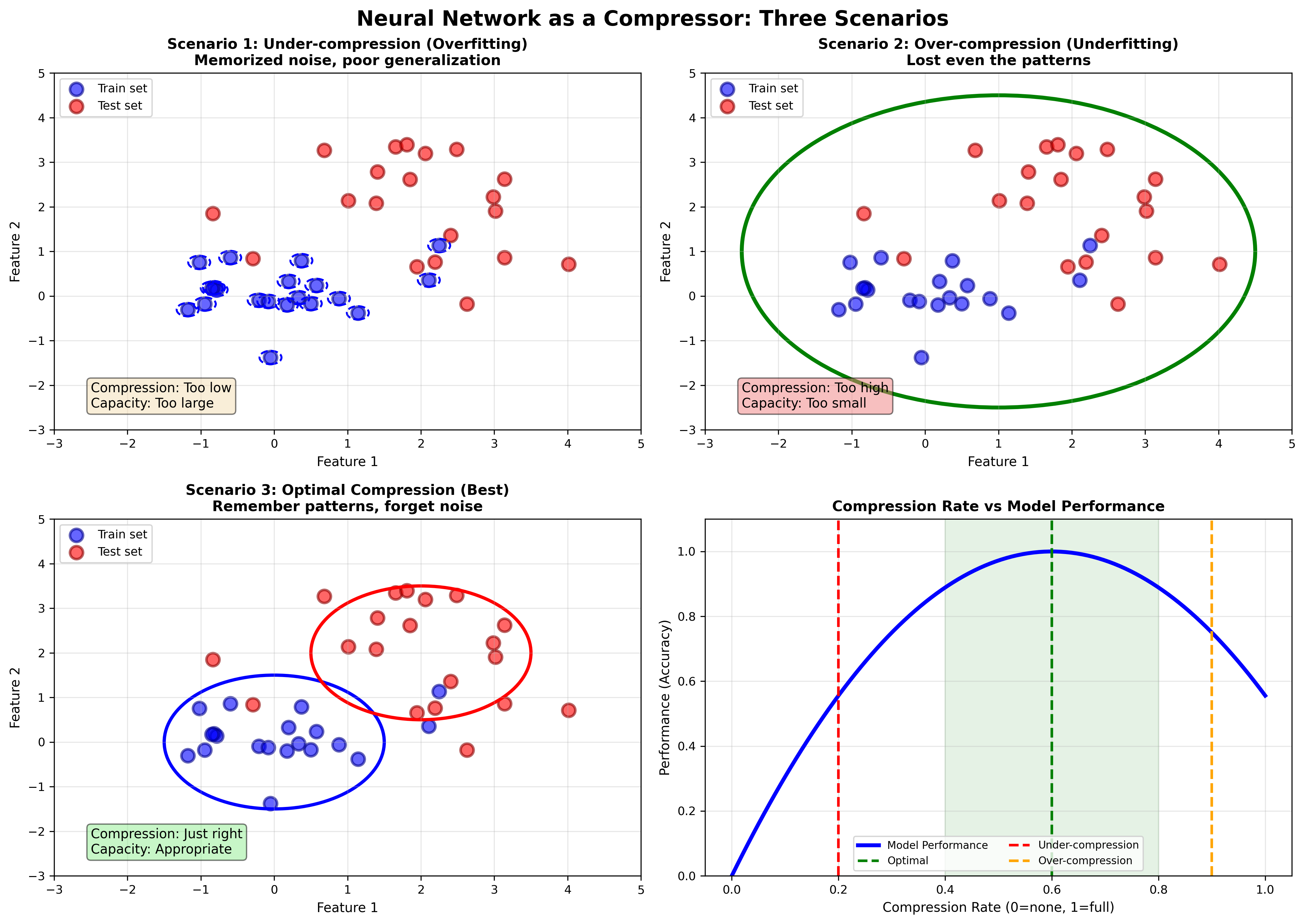

如图所示,神经网络作为压缩器有三种典型场景:

过拟合 = 欠压缩

网络把噪声也记住了。这就像你背课文,不仅记住了内容,还记住了第3页第2段有个错别字——这种"过度精确"反而降低了泛化能力。

症状:训练集99%准确率,测试集60%准确率

压缩诊断:压缩率太低,应该减少参数、增强正则化

欠拟合 = 过压缩

网络连规律也没记住。这就像你把《红楼梦》压缩成"贾宝玉和林黛玉的爱情悲剧"——信息损失太大,失去了细节和微妙之处。

症状:训练集和测试集都很差

压缩诊断:压缩率太高,应该增加网络容量

最佳状态 = 黄金压缩率

网络记住了规律,忘记了噪声。这需要:

- 合适的网络容量(既不能太大,也不能太小)

- 充足但不过量的训练数据

- 巧妙的正则化手段(Dropout、L2等)

四、信息瓶颈理论:数学视角的证明

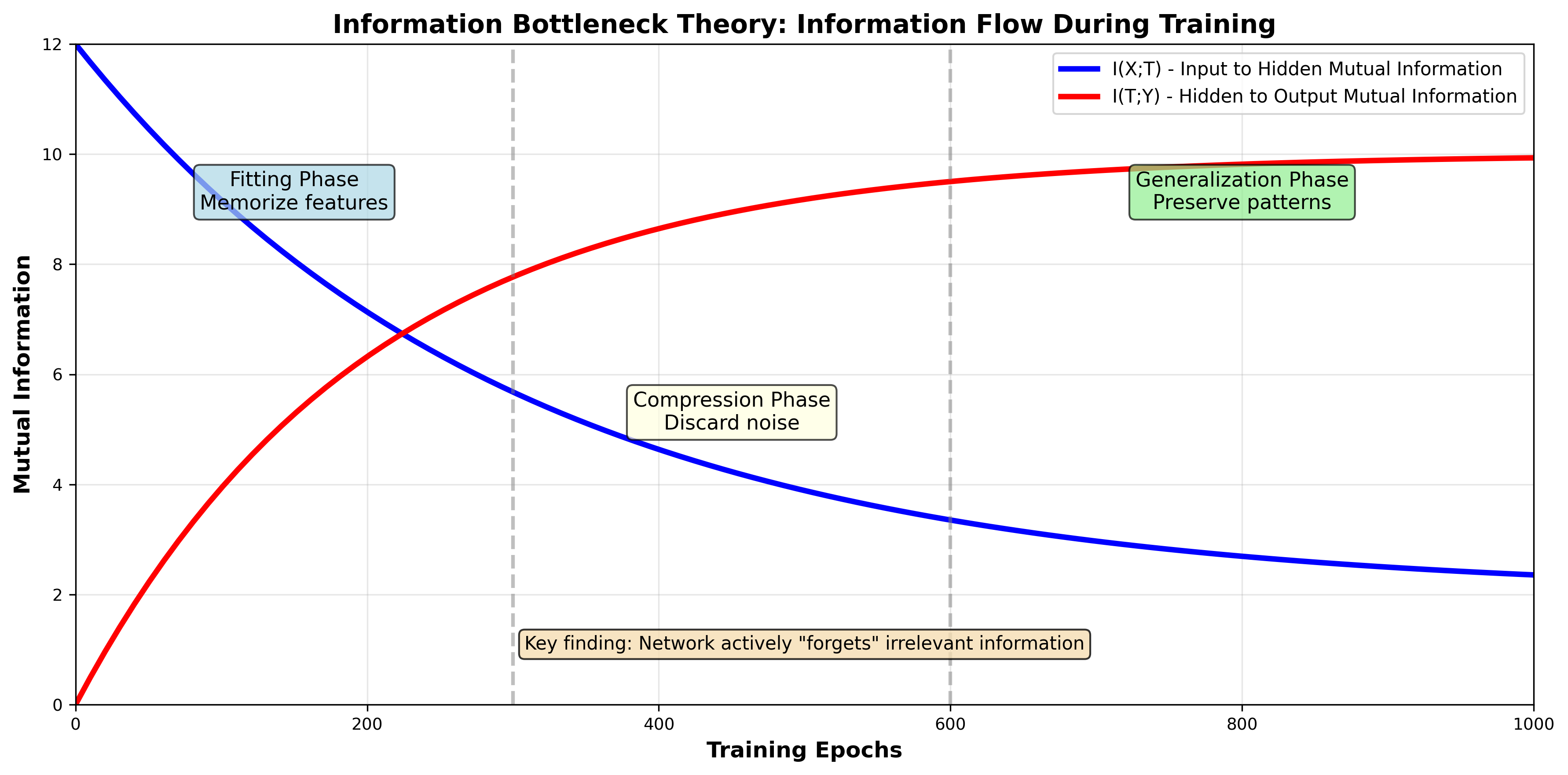

2015年,以色列学者Naftali Tishby提出了信息瓶颈理论(Information Bottleneck),用数学证明了神经网络确实是压缩器。

理论核心:训练过程中,网络在优化两个目标的权衡:

- 最大化:输出对标签的预测能力(I(X;Y))

- 最小化:输入对隐藏层的互信息(I(X;T))

翻译成人话:

- 第1条:网络要尽可能准确地预测

- 第2条:网络要尽可能压缩输入信息

这两个目标看似矛盾,实则统一。Tishby发现,在训练的中间阶段,网络会经历一个"压缩阶段"——此时准确率还在提升,但互信息在下降。网络主动丢弃无关信息,只保留对任务有用的特征。

这就像是你在备考时:

- 初期:什么都记(高互信息,低预测)

- 中期:发现重点是前三章,放弃后五章(压缩信息,提升预测)

- 后期:只看核心考点(低互信息,高预测)

神经网络也会"划重点"!

五、为什么这个视角有用?

理解"神经网络是压缩器",能帮你:

1. 选择合适的模型大小

如果你的数据只有1000张图片,用GPT-3级别的模型纯属浪费——大容量意味着低压缩率,容易过拟合。反过来,如果用10个参数去拟合ImageNet,那就是过压缩,根本学不出来。

经验法则:模型容量应该和数据复杂度匹配,就像选择压缩软件的质量参数。

2. 理解蒸馏和剪枝

模型蒸馏为什么有效?因为教师网络已经完成了"压缩",学生网络学习的是压缩后的知识,而不是原始数据。

剪枝为什么可行?因为网络中存在大量冗余参数(就像ZIP文件的冗余编码),去掉不影响压缩效果。

3. 预训练的魔法

BERT、GPT为什么强大?因为它们在海量文本上完成了超强压缩,学到了语言的底层规律。当你微调时,不是从零开始,而是在一个"已经压缩好世界知识"的模型上做微调。

这就像你不是从零学英语,而是背完了《牛津词典》后再学写作。

六、类比:人类大脑也是压缩器

其实,这个观点在生物学上也说得通。

人类大脑有860亿神经元,但一生中接收的信息量远远超过这个容量。我们能记住童年的一件事,却记不住昨天午餐的每一口味道——大脑也在压缩。

- 记住:奶奶家的味道(规律)

- 忘记:2021年3月18日吃了什么(噪声)

- 记住:E=mc²(本质)

- 忘记:第几次见到这个公式(细节)

甚至连"理解"本身,可能就是一种压缩形式的存储。你理解了量子力学,意味着你用几个核心定律压缩了大量实验现象。

深度学习,不过是在硅基上重现碳基的压缩魔法。

七、压缩的极限:我们还能走多远?

如果神经网络是压缩器,那么终极问题是:理论上能压缩到什么程度?

对于NLP任务,GPT-3证明了一个千亿参数的模型可以压缩互联网的大部分文本。但这是极限吗?

我们不知道。但有几个方向值得关注:

- 稀疏激活:MoE(混合专家)模型证明,不需要激活所有参数,每次只用1-2%——这就像动态压缩

- 高效架构:Transformer证明了"注意力机制"是一种高效的压缩方式

- 元学习:学会如何学习,本质上是压缩"学习本身"的规律

也许未来的AI,不是参数更多,而是压缩得更聪明。

结语

重新审视神经网络,你会发现它不再是黑魔法,而是一个优雅的信息处理机器:

输入数据 → 提取规律(压缩) → 丢弃噪声 → 形成简洁表示 → 用于预测(解压)

这个框架解释了为什么深度学习有效,也指明了它的边界。过拟合是压缩不够,欠拟合是压缩过度,泛化是恰到好处的有损压缩。

下次有人问你"神经网络到底在做什么",你可以神秘地微笑:

"它在宇宙的噪声中,寻找上帝留下的压缩算法。"

然后补充一句:"就像我们在婴儿啼哭中,听出'饿了'或'困了'——人类大脑,也是这样进化而来的。"

延伸思考:

- 如果神经网络是压缩器,那意识的本质是什么?是解压后的"体验"吗?

- 量子计算会带来新的压缩范式吗?

- 当压缩率超过某个阈值,会产生"涌现"吗?

这些问题,留给未来的你,或你的AI助手。

本文2025年重写,原观点来自作者对神经网络本质的思考。技术细节参考了Naftali Tishby的信息瓶颈理论和DeepMind的相关研究。

本文由作者 twg2020 创作,使用 AI 辅助润色

首发于:somingbai.com

时间:2021-03-18